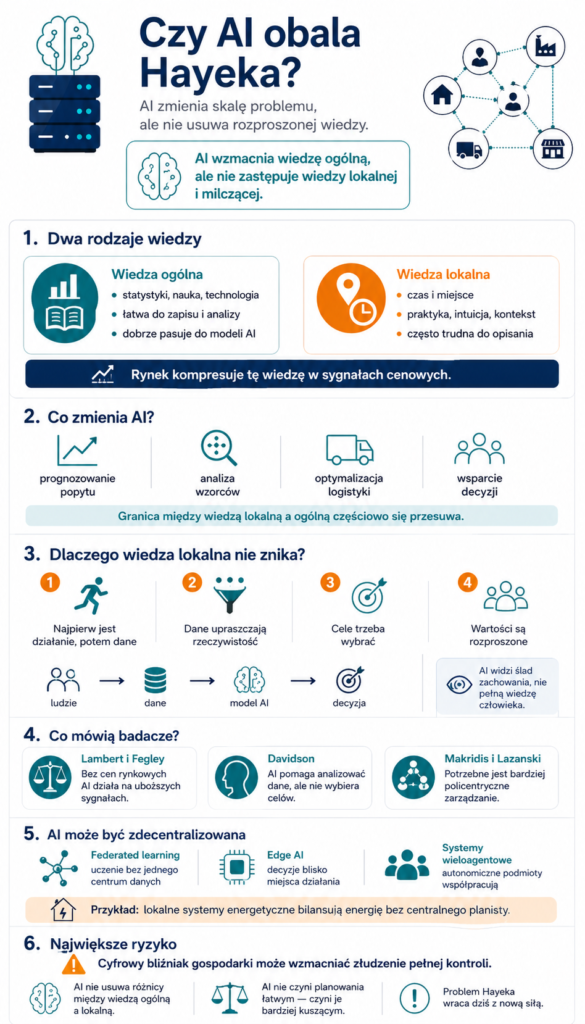

Jeśli sztuczna inteligencja potrafi analizować miliardy rekordów, przewidywać popyt i optymalizować logistykę, to czy argument Hayeka o rozproszonej wiedzy nadal ma znaczenie? W dużym skrócie, AI zmienia tylko skalę problemu, ale go nie usuwa.

Parę miesięcy temu opublikowałem dłuższa wersję artykułu opisującą problem dwóch rodzajów wiedzy, uznałem jednak że dobrze jest dodać też skrócona wersję

Hayek i dwa rodzaje wiedzy

W eseju „The Use of Knowledge in Society” z 1945 roku Hayek twierdził, że główny problem gospodarki centralnie planowanej nie polega na samym wykonywaniu obliczeń, ale na wykorzystaniu wiedzy nieusuwalnie rozproszonej między miliony jednostek.

Hayek rozróżniał dwa rodzaje wiedzy. Pierwsza to wiedza ogólna: naukowa, statystyczna, technologiczna. Można ją zapisać, skatalogować i uczyć jej na uczelniach. Druga to wiedza lokalna, o konkretnych okolicznościach czasu i miejsca: który dostawca się spóźnia, jakie maszyny w konkretnej fabryce zaczynają szwankować, gdzie właśnie otwiera się nisza rynkowa. Ta wiedza jest często milcząca. Ludzie po prostu wiedzą, jak coś zrobić, ale nie zawsze potrafią to precyzyjnie opisać.

Badacze wiedzy wyróżniają szereg innych rodzajów informacji (doświadczenie, intuicja, itd.), natomiast w kontekście centralnego planowania, można je wszystkie pogrupować do dwóch rodzajów.

Centralny planista z definicji widzi świat przez opóźnione i uproszczone statystyki. Rynek odpowiada na ten problem mechanizmem cen, które streszczają rozproszone informacje w sygnałach dostępnych dla wszystkich.

Hayek rozwijał koncepcję Misesa, który mówił że przy braku cen rynkowych centralny rząd nie ma narzędzi pozwalających ocenić co opłaca się tworzyć. Hayek uważał że w ogóle nie da się w jednym miejscu zgromadzić wystarczającej liczby danych.

Co ciekawe, temat ten poruszał wcześniej Eduard Bernstein, czyli twórca współczesnej socjaldemokracji. W rozdziale 3 „Evolutionary Socialism” (1899): “Chodziłoby, łącznie w przemyśle i handlu, o około sto tysięcy przedsiębiorstw zatrudniających od pięciu do sześciu milionów osób, a w rolnictwie o ponad 300 tysięcy gospodarstw z ponad pięcioma milionami pracowników. Jak ogromnym zasobem osądu, wiedzy praktycznej i talentu administracyjnego musiałby dysponować rząd albo zgromadzenie narodowe, aby choćby sprostać najwyższemu kierownictwu lub kontroli zarządzania tak gigantycznym organizmem!”

Skąd wzięła się wiara w planowanie?

Idea centralnego planowania ma długą historię. Imperia kolonialne widziały gospodarkę przez porty, statki i księgi handlowe. Skoro dało się policzyć, ile cukru i srebra przepływa przez doki, pojawiała się pokusa, by traktować całą gospodarkę jak wielki magazyn.

Problem polegał na tym, że rejestry portowe nie pokazywały całej rzeczywistości. Poza nimi istniały lokalne targi, wymiana sąsiedzka, przemyt i szare rynki. To, co z perspektywy metropolii wyglądało jak zakłócenie, było w praktyce ważną częścią realnego życia gospodarczego. To napięcie między tym, co widać w tabelach, a tym, co dzieje się lokalnie, wróci później jako jedno z głównych osi argumentu Hayeka.

W XX wieku Oskar Lange zaproponował model socjalizmu rynkowego, w którym centralna komisja planowania wyznaczałaby ceny metodą prób i błędów. Problem gospodarki stawał się wtedy problemem danych i obliczeń. Hayek odpowiadał, że to założenie pomija sedno sprawy: znaczna część wiedzy nie istnieje wcześniej jako gotowy zbiór danych, ale dopiero wyłania się w działaniu ludzi, w konkurencji i odkryciach. Lange próbował argumentować że informację o tym co warto produkować, można wyciągać na podstawie długości kolejek pod sklepami, brzmi to jednak dość absurdalnie.

Co zmienia sztuczna inteligencja w kontekście dwóch rodzajów wiedzy?

Sztuczna inteligencja radykalnie zwiększa zdolność przetwarzania informacji. Potrafi przewidywać popyt, wykrywać wzorce konsumpcji, optymalizować łańcuchy dostaw i wspierać decyzje firm na skalę niewyobrażalną w czasach Hayeka.

Z jego perspektywy AI jest gigantycznym wzmocnieniem wiedzy ogólnej. Informacja, która dawniej funkcjonowała tylko jako lokalna obserwacja, dziś może trafić do modelu predykcyjnego. Granica między tym, co lokalne, a tym, co ogólne, rzeczywiście się przesuwa. Prosta wersja argumentu „tego nie da się scentralizować” wymaga więc korekty.

Dlaczego wiedza lokalna nie znika?

AI korzysta z danych, które już powstały. Zanim model coś „zobaczy”, ktoś musiał podjąć decyzję, odkryć okazję albo zmienić zachowanie. Nowa potrzeba, moda czy nisza rynkowa pojawia się najpierw w konkretnym miejscu i działaniu, a dopiero później zostawia ślad w danych. AI jest więc wtórna wobec realnego procesu społecznego.

Poza tym dane są uproszczeniem. Model widzi kliknięcia, transakcje i logi, ale nie widzi całego kontekstu: motywacji, relacji, lokalnych norm i intuicji. Dwie osoby mogą wykonać tę samą sekwencję kliknięć, kierując się zupełnie innymi powodami. AI widzi ślad zachowania, nie pełną wiedzę człowieka.

Jest jeszcze jeden wymiar problemu. AI może przetwarzać fakty, ale sama nie rozstrzyga, jakie cele należy realizować. Ktoś musi zdecydować, co system ma optymalizować: zysk, bezpieczeństwo, równość, reputację? Wiedza o wartościach i priorytetach jest sama w sobie rozproszona, zmienna i często nieuświadomiona.

Co mówią współcześni badacze?

Lambert i Fegley argumentują, że bez prywatnej własności i realnych cen dóbr kapitałowych AI operuje na pozornych informacjach. Nawet najszybszy model nie zastąpi struktury cen, która powstaje w rynkowej rywalizacji.

Davidson twierdzi, że AI może zmniejszyć ludzką ograniczoną racjonalność, bo pozwala analizować więcej danych. Nie usuwa jednak pytania, kto wybiera cele i które informacje uznaje za ważne.

Makridis i Lazanski piszą, że duże modele pracują na zagregowanych zbiorach, ale nie przechwytują lokalnych i milczących trendów. Dlatego potrzebne jest raczej policentryczne zarządzanie AI niż jeden centralny ośrodek decyzyjny.

Czy AI może być hayekowska?

Paradoksalnie, wiele współczesnych rozwiązań AI działa raczej w duchu Hayeka niż przeciw niemu.

Federated learning pozwala trenować modele bez przenoszenia wszystkich danych do jednego centrum. Edge AI oznacza, że decyzje są podejmowane lokalnie, na urządzeniach końcowych. Systemy wieloagentowe opierają się na autonomicznych podmiotach, które uczą się i negocjują między sobą.

W zdecentralizowanych systemach energetycznych domowe baterie i panele słoneczne mogą handlować energią bezpośrednio z sąsiadami. AI pomaga bilansować podaż i popyt lokalnie, bez centralnego planisty widzącego wszystko.

Technologia sama w sobie nie jest ani rynkowa, ani planistyczna. Wszystko zależy od instytucji i architektury systemu. AI może wzmacniać spontaniczny porządek albo służyć jego przechwyceniu przez centrum.

Niebezpieczeństwo: pokusa cyfrowego bliźniaka

Im więcej danych gromadzi centralne centrum, tym większa pokusa, by uznać swój model za pełny obraz rzeczywistości. To właśnie Hayek nazywał „fatal conceit”: zgubnym złudzeniem, że złożony porządek społeczny da się zaprojektować i kontrolować jak maszynę.

AI może to złudzenie wzmocnić, bo daje planistom narzędzia znacznie potężniejsze niż dawne tabele i urzędy statystyczne. Chińska koncepcja cyfrowego bliźniaka całej gospodarki jest tu dobrym przykładem: w teorii pozwoliłaby testować scenariusze polityki i przewidywać zakłócenia, ale model nadal widzi tylko to, co zostało zmierzone i zaklasyfikowane. Nie widzi motywacji, kreatywności, lokalnych praktyk i spontanicznych zmian preferencji.

—————————————————————————————————————————————–

AI powiększa zakres wiedzy ogólnej. Wiele sygnałów dawniej lokalnych i ulotnych można dziś mierzyć, zapisywać i analizować. Centralna koordynacja w niektórych obszarach staje się skuteczniejsza niż kiedykolwiek wcześniej.

Ale AI nie usuwa jakościowej różnicy między wiedzą ogólną a lokalną. Nadal istnieje wiedza powstająca w działaniu ludzi, w ich doświadczeniu, osądzie i wartościach, której nie da się w pełni przekształcić w dane.

AI nie czyni centralnego planowania łatwym. Czyni je bardziej kuszącym. I właśnie dlatego problem dwóch rodzajów wiedzy, zamiast zniknąć, powraca dziś z jeszcze większą siłą niż w 1945 roku.